Oggi annunciamo due nuove tecnologie per combattere la disinformazione, nuovi lavori per aiutare a educare il pubblico sul problema e partnership per aiutare a far avanzare rapidamente queste tecnologie e gli sforzi educativi.

Non c’è dubbio che la disinformazione sia diffusa. Ricerca che abbiamo sostenuto dal professor Jacob Shapiro a Princeton, aggiornato questo mese, ha catalogato 96 distinte campagne di influenza straniera rivolte a 30 paesi tra il 2013 e il 2019. Queste campagne, condotte sui social media, cercavano di diffamare persone importanti, persuadere il pubblico o polarizzare i dibattiti. Mentre il 26% di queste campagne ha preso di mira gli Stati Uniti, altri paesi presi di mira includono Armenia, Australia, Brasile, Canada, Francia, Germania, Paesi Bassi, Polonia, Arabia Saudita, Sud Africa, Taiwan, Ucraina, Regno Unito e Yemen. Circa il 93% di queste campagne prevedeva la creazione di contenuti originali, l’86% ha amplificato contenuti preesistenti e il 74% ha distorto fatti oggettivamente verificabili. Rapporti recenti mostrano anche che è stata diffusa disinformazione sul Pandemia di covid-19, portando a morti e ricoveri di persone alla ricerca di presunte cure ma in realtà pericolose.

Ciò che annunciamo oggi è una parte importante del programma Defending Democracy di Microsoft, che, oltre a combattere la disinformazione, aiuta a proteggere il voto attraverso ElezioneGuard e aiuta a proteggere le campagne e gli altri soggetti coinvolti nel processo democratico AccountGuard, Microsoft 365 per le campagne E Consulenti per la sicurezza elettorale. Fa anche parte di un obiettivo più ampio sulla protezione e la promozione del giornalismo, come hanno discusso Brad Smith e Carol Ann Browne nel loro I dieci principali problemi legati alla politica tecnologica per gli anni 2020.

Nuove tecnologie

La disinformazione si presenta in molte forme e nessuna tecnologia da sola risolverà la sfida di aiutare le persone a decifrare ciò che è vero e accurato. In Microsoft stiamo lavorando su due tecnologie separate per affrontare diversi aspetti del problema.

Uno dei problemi principali è deepfakeo media sintetici, ovvero foto, video o file audio manipolati dall'intelligenza artificiale (AI) in modi difficili da rilevare. Potrebbero far sì che le persone dicano cose che non hanno detto o siano luoghi in cui non erano, e il fatto che siano generati dall’intelligenza artificiale che può continuare ad apprendere rende inevitabile che batteranno la tecnologia di rilevamento convenzionale. Tuttavia, nel breve periodo, come le imminenti elezioni americane, le tecnologie di rilevamento avanzate possono essere uno strumento utile per aiutare gli utenti più esigenti a identificare i deepfake.

Oggi annunciamo Microsoft Video Authenticator. Video Authenticator può analizzare una foto o un video per fornire una percentuale di possibilità, o un punteggio di confidenza, che il supporto sia manipolato artificialmente. Nel caso di un video, può fornire questa percentuale in tempo reale su ciascun fotogramma durante la riproduzione del video. Funziona rilevando il confine di fusione del deepfake e degli elementi in dissolvenza o in scala di grigi che potrebbero non essere rilevabili dall'occhio umano.

Questa tecnologia è stata originariamente sviluppata da Microsoft Research in coordinamento con il team Responsible AI di Microsoft e il comitato Microsoft AI, Ethics and Effects in Engineering and Research (AETHER), un comitato consultivo di Microsoft che aiuta a garantire che la nuova tecnologia venga sviluppata e messa in campo in modo responsabile. Video Authenticator è stato creato utilizzando un set di dati pubblico da Faccia forense++ ed è stato testato su Set di dati della sfida di rilevamento DeepFakeentrambi modelli leader per la formazione e il test delle tecnologie di rilevamento dei deepfake.

Ci aspettiamo che i metodi per generare media sintetici continuino a diventare sempre più sofisticati. Poiché tutti i metodi di rilevamento dell’intelligenza artificiale hanno tassi di fallimento, dobbiamo comprendere ed essere pronti a rispondere ai deepfake che sfuggono ai metodi di rilevamento. Pertanto, a lungo termine, dobbiamo cercare metodi più forti per mantenere e certificare il autenticità di articoli di notizie e altri media. Oggi esistono pochi strumenti per garantire ai lettori che i media che vedono online provengano da una fonte attendibile e che non siano stati alterati.

Oggi annunciamo anche una nuova tecnologia in grado sia di rilevare contenuti manipolati sia di assicurare alle persone che i media che stanno visualizzando sono autentici. Questa tecnologia ha due componenti. Il primo è uno strumento integrato in Microsoft Azure che consente a un produttore di contenuti di aggiungere hash digitali e certificati a un contenuto. Gli hash e i certificati convivono quindi con il contenuto come metadati ovunque viaggi online. Il secondo è un lettore – che può esistere come estensione del browser o in altre forme – che controlla i certificati e abbina gli hash, facendo sapere alle persone con un alto grado di precisione che il contenuto è autentico e che non è stato modificato, oltre a fornire dettagli su chi lo ha prodotto.

Questa tecnologia è stata sviluppata da Microsoft Research e Microsoft Azure in collaborazione con il Defending Democracy Program. Alimenterà un'iniziativa di recente annunciato dalla BBC chiamato Origine del progetto.

Partenariati

Nessuna singola organizzazione sarà in grado di avere un impatto significativo sulla lotta alla disinformazione e ai deepfake dannosi. Faremo il possibile per aiutare, ma la natura della sfida richiede che più tecnologie siano ampiamente adottate, che gli sforzi educativi raggiungano i consumatori ovunque in modo coerente e che si continui a imparare di più sulla sfida man mano che si evolve.

Oggi mettiamo in evidenza le partnership che abbiamo sviluppato per sostenere questi sforzi.

Innanzitutto, collaboriamo con la AI Foundation, una doppia impresa commerciale e no-profit con sede a San Francisco, con la missione di portare la potenza e la protezione dell'IA a tutti nel mondo. Attraverso questa partnership, la Fondazione AI Difensore della realtà 2020 (RD2020) metterà Video Authenticator a disposizione delle organizzazioni coinvolte nel processo democratico, compresi organi di stampa e campagne politiche. Video Authenticator sarà inizialmente disponibile solo attraverso RD2020, che guiderà le organizzazioni attraverso le limitazioni e le considerazioni etiche inerenti a qualsiasi tecnologia di rilevamento dei deepfake. Campagne e giornalisti interessati a saperne di più possono contattare RD2020 Qui.

In secondo luogo, abbiamo collaborato con un consorzio di società di media tra cui BBC, CBC/Radio-Canada e New York Times Origine del progetto, che metterà alla prova la nostra tecnologia di autenticità e contribuirà a farla diventare uno standard che può essere adottato su larga scala. IL Iniziativa Trusted News, che comprende una serie di editori e società di social media, ha accettato di impegnarsi con questa tecnologia. Nei prossimi mesi, speriamo di estendere il lavoro in quest’area a un numero ancora maggiore di aziende tecnologiche, editori di notizie e società di social media.

Alfabetizzazione mediatica

Collaboriamo anche con l'Università di Washington (UW), Sensibilità e USA Today sull'alfabetizzazione mediatica. Migliorare l’alfabetizzazione mediatica aiuterà le persone a separare la disinformazione dai fatti autentici e a gestire i rischi posti dai deepfake e dai falsi economici. La conoscenza pratica dei media può consentire a tutti noi di pensare in modo critico al contesto dei media e diventare cittadini più coinvolti pur continuando ad apprezzare la satira e la parodia. Sebbene non tutti i media sintetici siano dannosi, è stato dimostrato che anche un breve intervento con risorse di alfabetizzazione mediatica aiuta le persone a identificarli e a trattarli con maggiore cautela.

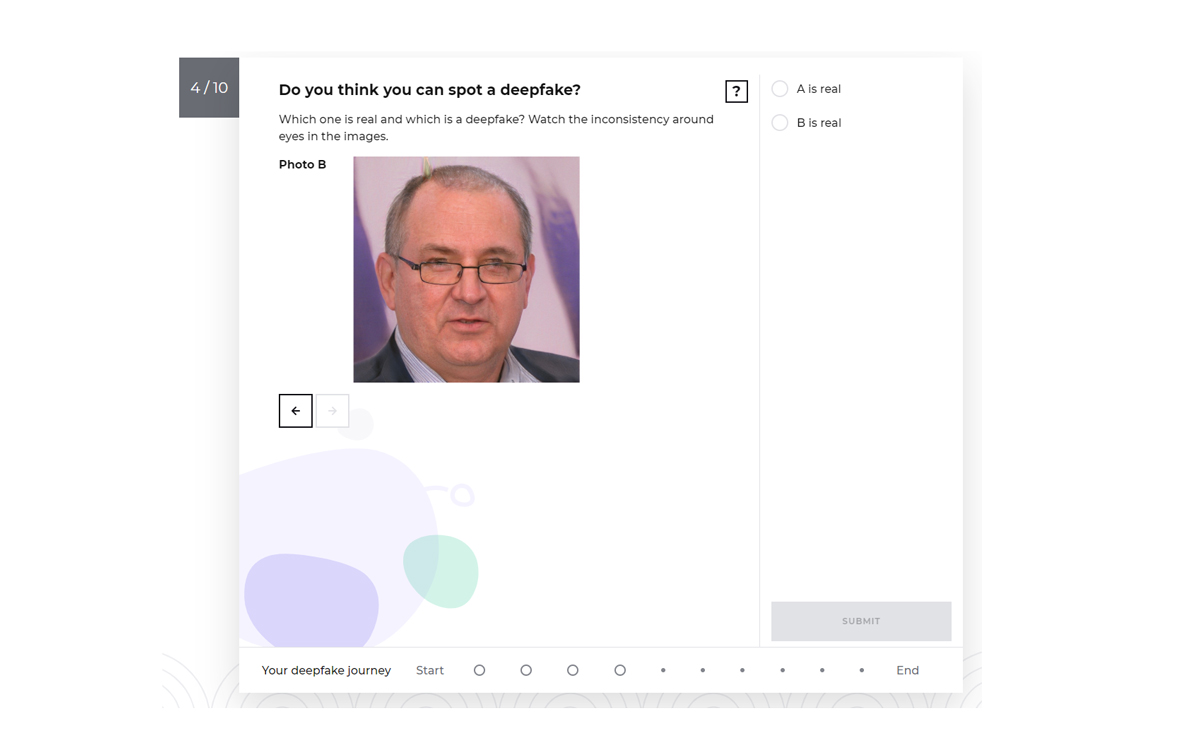

Oggi lanciamo un quiz interattivo consentire agli elettori negli Stati Uniti di conoscere i media sintetici, sviluppare competenze di alfabetizzazione mediatica critica e acquisire consapevolezza dell’impatto dei media sintetici sulla democrazia. Il quiz Spot the Deepfake è uno strumento di alfabetizzazione mediatica sotto forma di esperienza interattiva sviluppata in collaborazione con l'UW Centro per un pubblico informato, Sensibilità e USA Today. Il quiz sarà distribuito su proprietà web e social media di proprietà di USA Today, Microsoft e dell'Università di Washington e attraverso la pubblicità sui social media.

Inoltre, in collaborazione con il Associazione per le notizie digitali della radiotelevisione, Il progetto di fiducia e il Center for an Informed Public and Accelerating Social Transformation Program dell'UW, Microsoft sta supportando una campagna di annunci di servizio pubblico (PSA) che incoraggia le persone a fare una “pausa riflessiva” e a verificare che le informazioni provengano da un'organizzazione giornalistica rispettabile prima di condividerle o promuoverle. sui social media in vista delle imminenti elezioni americane. La campagna PSA aiuterà le persone a comprendere meglio il danno che la disinformazione e la disinformazione hanno sulla nostra democrazia e l’importanza di prendersi il tempo necessario per identificare, condividere e consumare informazioni affidabili. Gli annunci verranno trasmessi nelle stazioni radio degli Stati Uniti a settembre e ottobre.

Infine, negli ultimi mesi abbiamo notevolmente ampliato la nostra implementazione di NewsGuard, che consente alle persone di saperne di più su una fonte di notizie online prima di consumarne i contenuti. NewsGuard gestisce un team di giornalisti esperti che valutano i siti Web di notizie online sulla base di nove criteri di integrità giornalistica, che utilizzano per creare sia una “etichetta nutrizionale” che una classificazione rosso/verde per ciascun sito Web di notizie valutato. Le persone possono accedere al servizio di NewsGuard scaricando una semplice estensione del browser, disponibile per tutti i browser standard. È gratuito per gli utenti del browser Microsoft Edge. È importante sottolineare che Microsoft non ha alcun controllo editoriale su nessuna delle valutazioni di NewsGuard e l'estensione del browser NewsGuard non limita in alcun modo l'accesso alle informazioni. Invece, NewsGuard mira a fornire maggiore trasparenza e incoraggiare l’alfabetizzazione mediatica fornendo un contesto importante sulla fonte di notizie stessa.

Considerazioni politiche

I governi, le aziende, le organizzazioni no-profit e altri soggetti in tutto il mondo hanno un ruolo fondamentale da svolgere nell’affrontare la disinformazione e le interferenze elettorali in generale. Nel 2018, il Appello di Parigi per la fiducia e la sicurezza nel cyberspazio ha riunito un gruppo multilaterale di leader globali impegnati a rispettare nove principi che contribuiranno a garantire la pace e la sicurezza online. Uno dei principi più critici è la difesa dei processi elettorali. A maggio, Microsoft, l'Alleanza per la Sicurezza della Democrazia e il Governo del Canada lanciato uno sforzo per condurre le attività globali su questo principio. Incoraggiamo qualsiasi organizzazione interessata a contribuire aderire alla chiamata di Parigi.